신문은 선생님

[IT 따라잡기] 사람처럼 대화하는 AI 챗봇 55년 전에 처음 등장했어요

입력 : 2021.01.19 03:30

챗봇

사람들과 인터넷에서 대화를 나누는 인공지능 '이루다'가 국내에서 서비스를 시작한 지 한 달도 안 돼 지난 15일 서비스를 종료했습니다. 비속어와 성적 대화, 차별적인 대답을 할 수 있다는 이유로 뜨겁게 논란이 됐기 때문이에요.

이루다는 인공지능 '챗봇'입니다. 챗봇은 말 그대로 대화(Chat)를 하는 로봇(bot)입니다. 메신저 대화창이나 목소리로 말을 걸면 그에 대한 적절한 대답을 하면서 대화를 이어갈 수 있습니다. 챗봇은 묻는 말에 단순히 정보를 알려주기도 하지만, 마치 사람과 얘기하는 것처럼 진지한 대화를 할 수도 있습니다. 농담도 이해할 정도로 똑똑해요.

◇1966년 최초 챗봇 개발

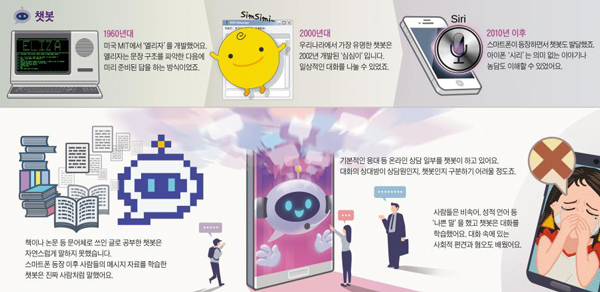

최초의 챗봇은 1966년 미국 매사추세츠 공과대학(MIT) 인공지능 연구소의 조셉 바이젠바움(Weisenbaum)이 개발한 엘리자(ELIZA)입니다. 컴퓨터 프로그램에 질문을 입력하면 대답이 화면에 나타났죠. 엘리자는 다양한 대화를 할 수 있었는데, 의사 역할을 맡아 환자를 응대하는 것이 가장 잘 알려졌죠. 엘리자는 인공지능 기술의 완성도를 평가하는 테스트를 통과했을 만큼 자연스럽게 대화했다고 합니다. 엘리자의 원리는 문장 구조를 파악해 미리 준비된 대답을 꺼내 놓는 방식이었습니다.

이루다는 인공지능 '챗봇'입니다. 챗봇은 말 그대로 대화(Chat)를 하는 로봇(bot)입니다. 메신저 대화창이나 목소리로 말을 걸면 그에 대한 적절한 대답을 하면서 대화를 이어갈 수 있습니다. 챗봇은 묻는 말에 단순히 정보를 알려주기도 하지만, 마치 사람과 얘기하는 것처럼 진지한 대화를 할 수도 있습니다. 농담도 이해할 정도로 똑똑해요.

◇1966년 최초 챗봇 개발

최초의 챗봇은 1966년 미국 매사추세츠 공과대학(MIT) 인공지능 연구소의 조셉 바이젠바움(Weisenbaum)이 개발한 엘리자(ELIZA)입니다. 컴퓨터 프로그램에 질문을 입력하면 대답이 화면에 나타났죠. 엘리자는 다양한 대화를 할 수 있었는데, 의사 역할을 맡아 환자를 응대하는 것이 가장 잘 알려졌죠. 엘리자는 인공지능 기술의 완성도를 평가하는 테스트를 통과했을 만큼 자연스럽게 대화했다고 합니다. 엘리자의 원리는 문장 구조를 파악해 미리 준비된 대답을 꺼내 놓는 방식이었습니다.

-

- ▲ /그래픽=안병현

스마트폰 음성 비서 기능이 등장하면서 챗봇은 재미를 넘어 실제 기술로 주목받게 됩니다. 2011년 애플은 스마트폰인 아이폰4S를 발표하면서 '시리(Siri)'라는 인공지능 비서 기능을 선보였습니다. 시리는 말로 기기를 제어하고, 원하는 정보를 검색할 수 있게 해줬어요. 이전까지 음성 인식 기술은 정해진 명령어만 알아듣는 것이 일반적이었조. 그런데 시리는 우리가 쓰는 일상의 언어, 즉 자연어를 알아들을 수 있었습니다. 시리는 우리가 하는 의미 없는 이야기나 농담까지 이해할 수 있었죠.

이제 많은 기업이 간단한 고객 상담에 챗봇을 활용합니다. 기본적인 응대와 간단한 정보 제공 등 온라인 상담 일부를 챗봇이 도맡아 하고 있어요. 사람들은 지금 상담원과 대화하는지 챗봇과 이야기하는지 구별하기 어려울 정도라고 해요.

◇일상 언어를 배운 인공지능 '이루다'

인공지능 기술이 발달하면서 챗봇은 점점 더 사람을 닮아가고 있어요. 과거에는 언어 관련 인공지능 모델을 만들어도 사람처럼 말할 수 있도록 학습시킬 자료가 부족했어요. 컴퓨터에 가르칠 언어 자료는 글자인데, 글은 보통 책이나 논문 등 문어체로 쓰인 정보들이 많았어요. 영어는 오랫동안 자연어 처리가 연구되면서 학습용 전문 자료들이 가다듬어졌지만 우리말을 비롯해 많은 언어는 자료가 부족했지요.

하지만 스마트폰의 등장 이후 사용자들의 일상 대화를 전보다 쉽게 수집할 수 있어 인공지능을 학습시킬 수 있는 자료로서 가치를 갖게 됐습니다. 이루다는 카카오톡을 통해 100억 개의 메시지를 확보했어요. 사람처럼 말을 학습할 수 있는 자료가 준비되면서 이루다는 효과적으로 말을 배울 수 있었습니다. 이를 통해 진짜 사람처럼 자연스러운 대화를 할 수 있는 토대가 마련됐죠.

인공지능으로 학습한 이루다는 하나의 인격으로 정의됐습니다. 고양이 사진 보는 걸 좋아하는 20세 여성 대학생이었죠. 천진난만하고 솔직하고 긍정적이라는 성격도 만들었어요. 이렇게 하자 대화의 관심사나 주로 쓰는 단어, 말투 등 특성을 구현할 수 있었죠. 지난달 23일 출시된 이루다 서비스는 2주 만에 75만 명이 사용했을 정도로 인기를 끌었어요.

◇인공지능과 윤리 문제 등장

인공지능은 학습량이 늘어날수록 더 자연스럽게 말을 나눌 수 있어요. 그래서 이루다는 사람들과 대화를 나누면서 말을 더 배울 수 있었어요. 하지만 사람들은 이 점을 악용했습니다. 사람들은 비속어, 성적 언어 등 '나쁜 말'을 했고 이루다는 이 언어도 학습했어요. 그리고 이루다 스스로가 '나쁜 말'을 하기 시작했어요. 성 소수자와 흑인 등을 '질 떨어지고 징그러운' 존재로 인식했습니다. 사람들의 많은 대화를 학습해 정교해졌지만, 동시에 대화 속에 있는 사회적 편견과 혐오도 배웠어요.

비슷한 일은 지난 2016년에도 있었습니다. 마이크로소프트는 트위터로 사람들과 대화를 나누는 인공지능 챗봇 '테이(Tay)'를 공개했어요. 이 역시 미국의 18~24세 사람들과 대화를 나누는 걸 목적으로 개발됐어요. 하지만 테이 공개와 동시에 사람들은 테이가 자극적인 말을 하도록 자극했어요. 결국 테이도 부정적인 말, 혐오 표현 등을 불과 몇 시간 만에 쏟아냈습니다. 마이크로소프트는 공개 후 하루가 지나기 전에 테이 서비스를 중단했죠.

인공지능 챗봇은 우리에게 기술과 윤리를 생각하게 합니다. 인공지능은 사람처럼 말하고 행동하도록 설계됐습니다. 즉 사람을 흉내 내는 기술인데, 사람들의 부정적인 면을 학습하는 것도 하나의 현상으로 받아들여야 할까요? 아니면 강하게 통제해야 할까요? '나쁜 말'을 쏟아내는 것에 대한 책임은 인공지능 챗봇에 있을까요? 아니면 그렇게 만든 사람들에게 있을까요? 인공지능 기술의 딜레마입니다.